人工智能会取代软件工作吗?

- Patrick Collins

- 发布于 2025-03-04 11:17

- 阅读 2078

这篇文章探讨了人工智能对软件工程行业的影响,分析了AI在编程任务中的优势与局限性,以及对初级开发者职位的威胁。尽管AI可能取代部分工作,但高级工程师将能通过与AI合作提高生产力。未来的职业要求将日益增加,软件工程的入门门槛也会随之提高。

是的,人工智能将会取代一些软件工程职位,但情况比这更复杂。根据最新数据:

如果你是计算机科学学生或软件专业人士,想要了解在人工智能时代你的职业前景,我们深入探讨一下真的发生了什么。

可以在这里观看我整个视频。

从DeepSeek 最近的论文来看,他们的 AI 模型在竞争编程中超越了绝大多数基础和中级软件工程师,以及许多其他智能基准。

人工智能擅长已见过的任务。AI 系统是在巨大的数据集上训练的,这些数据集包括人们已完成的工作、他们解决的常见问题以及他们犯的典型错误。

因此,我认为最脆弱的角色是初级开发人员。公司将越来越多地使用人工智能工具来处理这些简单的任务,而不是支付初级开发人员。

人工智能的局限性

他们夺走了工作!

然而,作为一名工程师,我要指出这些简单的挑战(例如 LeetCode 和这些基准训练出来的代码挑战)并不代表真实世界的编码。真实的生产代码优先考虑可读性,并考虑系统架构和设计——而许多算法挑战并未涉及这些方面。

这里有一个至关重要的因素:AI 模型的有效性仅与其训练数据的质量有关。

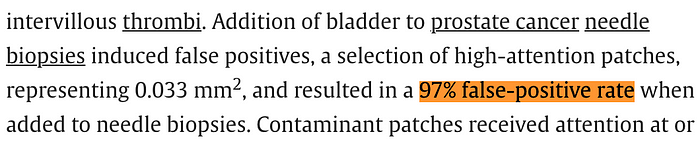

《现代病理学》(Modern Pathology)上发表的一项研究展示了这一局限性。当研究人员使用 AI 模型检测血液中的异常、估计组织年龄和分类受损组织时,他们发现当 AI 遇到污染或未见过的数据时,性能大幅下降:

- 在某些情况下,准确率从 74% 下降到 69%

- 年龄估算错误增加了 46%

- 前列腺癌检测导致 97% 的假阳性率

摘自现代病理学

这个问题很严重,因为在现实环境中,大约 3% 的切片存在某种形式的污染。相比之下,人类病理学家在处理这些边缘情况时,错误率极低。

现在对 AI 来说,解决方案很简单,只需在这些边缘情况中训练 AI,但这仍然显示了 AI 的问题。当 AI 没有见过某件事时,它的错误率会飙升。

人类与 AI 的合作

编码的未来:我们都是半机械人

根据我个人使用 AI 助手的经验,我经常会收到立即识别为不理想的建议。我可以识别出问题,并利用我的专业知识改进 AI 的工作。

这种模式可能会继续下去。虽然初级软件工程师可能会被取代,但中级和高级工程师将通过将 AI 作为工具来提高他们的生产力——获取 AI 系统的初步输出,然后应用他们的专业知识进行改进。

我预计这种人类与 AI 的协作模式将扩展到大多数知识职业。医生会将 AI 的建议作为起点,但依靠自身的专业知识来做出最终决定。软件工程师也将遵循类似的模式。

知识门槛的上升

这意味着,参加两周的训练营后立即获得六位数工作的日子已经结束——这可能是好事。

成为软件工程师的知识要求正在提高:

- 在 2022 年,你可以完成短期训练营并可能找到高薪工作

- 到 2024 年,门槛提高——你可能需要数年的努力工作和开源贡献

- 在未来,先决知识的要求将继续增加

作为比较,医生需要广泛的知识,通常在 30 岁之前并不稳定。我相信,随着人工智能使学习更加容易,各行各业对知识的要求都会增加。

行业领袖的看法

Joe Rogan Experience #2255 - Mark Zuckerberg

马克·扎克伯格在乔·罗根的播客上表示:

大概在 2025 年,我们在 Meta 以及其他正在进行此工作的公司,将会拥有一种能够有效成为你公司内中级工程师的 AI,可以编写代码。

像 Salesforce 这样的公司已经暂停了新软件工程师的招聘。虽然我认为这在一定程度上是对疫情期间激进招聘的市场调整。

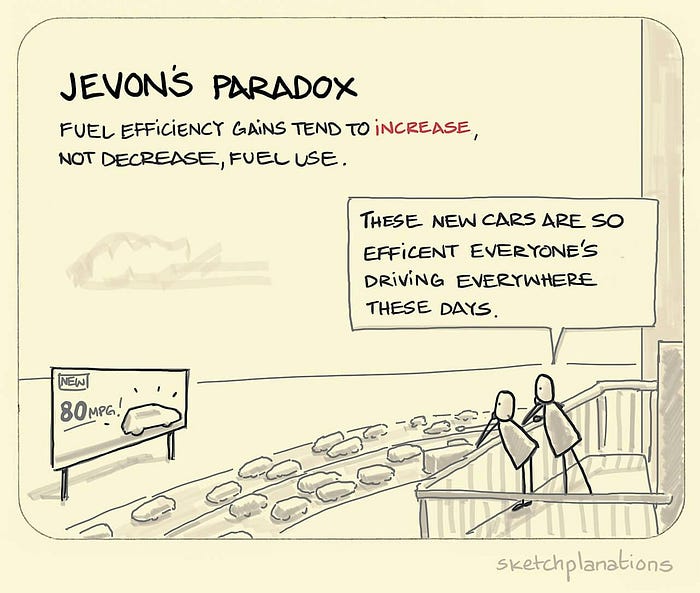

杰沃恩斯悖论:为什么 AI 可能会真正增加需求

原始图片来自sketchplanations

杰沃恩斯悖论出现了。该经济理论以经济学家威廉·斯坦利·杰沃恩斯命名,认为当技术进步提高资源的效率时,该资源的消费速率可能会增加而不是减少。

此悖论的实例:

- 随着计算能力变得更便宜,需求飙升

- 随着汽车燃油效率提高,汽车驾驶数量增加

应用到软件开发,AI 使软件创建变得更便宜,这实际上可能会增加需求。随着软件开发成本降低,我们可能会看到新应用和系统激增,潜在地创造更多的工作,而不是更少。

然而,获得这些工作的先决知识将保持在比以前更高的水平。

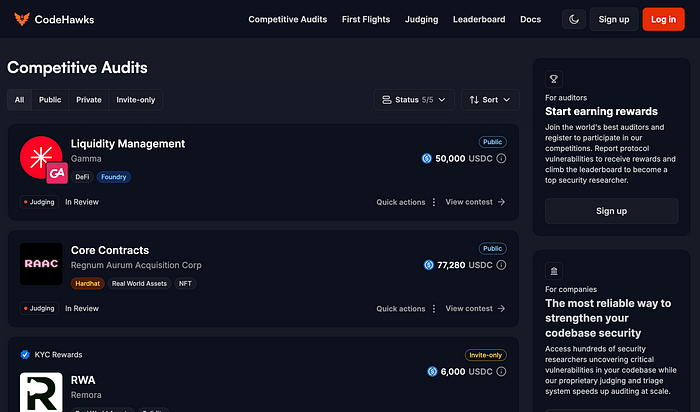

安全研究员例外

CodeHawks 竞争安全审查平台

这个趋势有一个显著的例外:安全研究者。技术安全研究者仍然需要广泛的先决知识,但他们可以通过漏洞奖励和竞争审计(如CodeHawks)来证明他们的技能。

随着 AI 生成代码的普及,安全变得更加重要。虽然一项有争议的研究声称使用 AI 导致了 41% 的漏洞增加,但是方法论存在缺陷。然而,这个担忧是合理的。

在关键应用中——如对生命安全的医疗设备,或处理数十亿资金的智能合约——漏洞可能是灾难性的。经过人类编码训练的 AI 会继承人类的错误。这就是为什么安全专业知识仍然不可或缺。

根据我作为区块链工程师的经验,我测试了许多 AI 审计工具,发现与传统静态分析相比,它们表现不佳。虽然 AI 工具可能有助于模糊测试和理解不变量,但它们仍无法取代人类的安全专家。

区块链安全的优势

区块链安全研究人员和智能合约工程师可能比其他行业的人员更安全。在区块链中,一处单一的漏洞可能导致协议被攻击和摧毁。我们已经看到由 AI 审计的协议随后被黑客入侵。

最终,AI 可能在安全分析方面超过大多数人类,但那个未来距离我们还有一段时间。在可预见的未来,人类与 AI 的混合方法将产生更好的结果。

数据干旱

有趣的是,随着 AI 能力的提高,我们正看到训练数据的短缺。历史上,AI 在像 Stack Overflow 这样的论坛上进行训练,但随着人们与 AI 互动而非这些平台,许多数据源正在枯竭。因此,人工智能不得不....用自己进行训练。

此外,许多网站正在实施robots.txt 文件,以防止爬虫收集它们的数据,进一步限制新的训练材料。

如何保持相关

那么,如果你担心你的软件或安全的未来该怎么办呢?

- 不断学习:如果你获得学位后决定不再学习,人工智能将会取代你的工作。通过不断学习和成长保持相关。

- 接受人工智能工具:利用这些工具提高效率,但要理解它们的工作原理。了解它们生成的代码,以便有效实施。

- 理解人工智能局限性:认识到AI是基于历史数据训练的,这是滞后指标。例如,当前的AI工具可能仍然推荐pip,而不是像uv这样的更新、更好的工具。你的前沿知识使你处于优势地位。

- 考虑安全:在关键系统中,错误的后果可能是严重的。随着 AI 生成代码的普及,安全专业知识将保持价值。

未来是协作的

我的看法是:许多初级角色将消失,但这不一定是坏事。社会将因为人工智能而更加迅速地推进,实现更多技术进步。然而,你将需要提高你的技能,以便在这个新环境中提供价值。

人工智能最终仅仅是一个工具——一个可以帮助我们构建更好的系统、更安全的智能合约和更美好的未来的工具。那些学会与 AI 有效合作的人,将在人类无法完全解决的问题上发挥专业知识的价值,从而在未来几年中取得成功。

参考文献

- 原文链接: medium.com/cyfrin/is-ai-...

- 登链社区 AI 助手,为大家转译优秀英文文章,如有翻译不通的地方,还请包涵~

- 追随本心:恐慌是真实的,机遇更大 191 浏览

- 如何在AI时代变得不可替代 90 浏览

- 来自 Tomasz 的更新 459 浏览

- 什么是概念推理? 622 浏览

- 2026年加密货币研究工具指南 1427 浏览

- 软件工程的未来两年 856 浏览

- 廉价生成与理解的脆弱性 650 浏览

- 安全研究员巅峰指南:扬帆起航 993 浏览

- 即将到来的QA测试大爆发 139 浏览

- Cuechain的AI套件:在Solana上驱动智能自动化 931 浏览

- “天才实习生”问题:为什么区块链是唯一足够强大的手铐,可以约束…… 1166 浏览

- 预测性DeFi:利用AI在危机发生前发现问题 796 浏览